In questo tutorial, ti mostreremo come installare Apache Spark sul server CentOS 7. Per chi non lo sapesse, Apache Spark è un sistema di cluster computing veloce e generico Fornisce API di alto livello in Java, Scala e Python e anche un motore ottimizzato che supporta i grafici di esecuzione complessivi Supporta anche un ricco set di strumenti di livello superiore tra cui Spark SQL per SQL ed elaborazione di informazioni strutturate, MLlib per la macchina apprendimento, GraphX per l'elaborazione dei grafici e Spark Streaming.

Questo articolo presuppone che tu abbia almeno una conoscenza di base di Linux, sappia come usare la shell e, soprattutto, che ospiti il tuo sito sul tuo VPS. L'installazione è abbastanza semplice e presuppone che tu sono in esecuzione nell'account root, in caso contrario potrebbe essere necessario aggiungere 'sudo ' ai comandi per ottenere i privilegi di root. Ti mostrerò l'installazione passo passo di Apache Spark sul server CentOS 7.

Installa Apache Spark su CentOS 7

Passaggio 1. Innanzitutto, iniziamo assicurandoci che il tuo sistema sia aggiornato.

yum clean all yum -y install epel-release yum -y update

Passaggio 2. Installazione di Java.

Installazione di java per il requisito install apache-spark:

yum install java -y

Una volta installato, controlla la versione java:

java -version

Passaggio 3. Installazione di Scala.

Spark installa Scala durante il processo di installazione, quindi dobbiamo solo assicurarci che Java e Python siano presenti:

wget http://www.scala-lang.org/files/archive/scala-2.10.1.tgz tar xvf scala-2.10.1.tgz sudo mv scala-2.10.1 /usr/lib sudo ln -s /usr/lib/scala-2.10.1 /usr/lib/scala export PATH=$PATH:/usr/lib/scala/bin

Una volta installato, controlla la versione scala:

scala -version

Passaggio 4. Installazione di Apache Spark.

Installa Apache Spark utilizzando il comando seguente:

wget http://www-eu.apache.org/dist/spark/spark-2.2.1/spark-2.2.1-bin-hadoop2.7.tgz tar -xzf spark-2.2.1-bin-hadoop2.7.tgz export SPARK_HOME=$HOME/spark-2.2.1-bin-hadoop2.7 export PATH=$PATH:$SPARK_HOME/bin

Imposta alcune variabili di ambiente prima di avviare spark:

echo 'export PATH=$PATH:/usr/lib/scala/bin' >> .bash_profile echo 'export SPARK_HOME=$HOME/spark-2.2.1-bin-hadoop2.6' >> .bash_profile echo 'export PATH=$PATH:$SPARK_HOME/bin' >> .bash_profile

Il cluster Spark autonomo può essere avviato manualmente, ovvero eseguendo lo script di avvio su ciascun nodo o semplicemente utilizzando gli script di avvio disponibili. Per i test possiamo eseguire demoni master e slave sulla stessa macchina:

./sbin/start-master.sh

Passaggio 5. Configura Firewall per Apache Spark.

firewall-cmd --permanent --zone=public --add-port=6066/tcp firewall-cmd --permanent --zone=public --add-port=7077/tcp firewall-cmd --permanent --zone=public --add-port=8080-8081/tcp firewall-cmd --reload

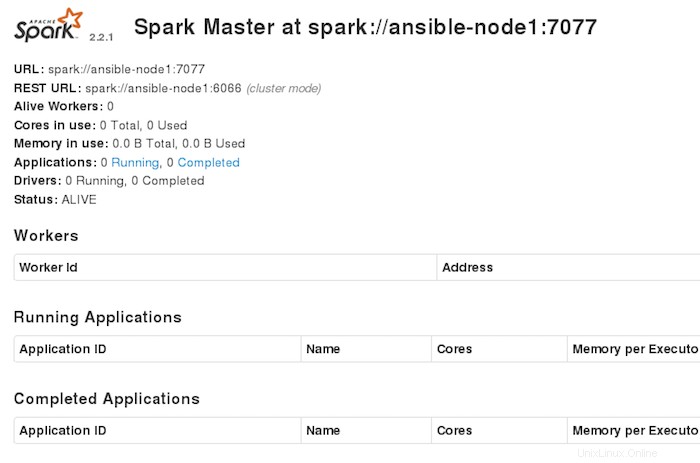

Passaggio 6. Accesso ad Apache Spark.

Apache Spark sarà disponibile sulla porta HTTP 7077 per impostazione predefinita. Apri il tuo browser preferito e vai a http://yourdomain.com:7077 o http://your-server-ip:7077 e completa i passaggi richiesti per completare l'installazione.

Congratulazioni! Hai installato con successo Apache Spark su CentOS 7. Grazie per aver utilizzato questo tutorial per l'installazione di Apache Spark su sistemi CentOS 7. Per ulteriore aiuto o informazioni utili, ti consigliamo di controllare l'Apache ufficiale Sito web Spark.